productNVIDIA

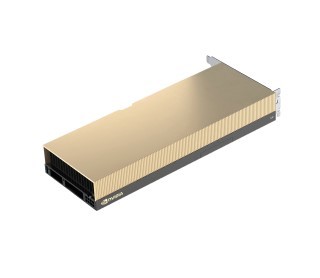

A30

メインストリームエンタープライズサーバーのための多彩なコンピューティング高速化

A30

NVIDIA A30 TensorコアGPUは、NVIDIA Ampereアーキテクチャを採用した、メインストリームエンタープライズサーバー向けのデータセンターGPUです。

特長

あらゆる企業を対象としたAI推論およびメインストリームコンピューティング

NVIDIA A30 TensorコアGPUは、AI推論およびメインストリームエンタープライズワークロードのための最も汎用的なメインストリームコンピューティングGPUです。NVIDIA AmpereアーキテクチャTensorコアテクノロジにより、幅広い計算精度をサポートし、単一アクセラレータであらゆるワークロードを高速化します。大規模なAI推論向けに構築された同一のコンピューティングリソースにて、AIモデルをTF32で素早く再トレーニングし、HPC(ハイパフォーマンス コンピューティング)アプリケーションをFP64 Tensorコアを用いて高速化できます。Multi-Instance GPU(MI)とFP64 Tensorコアは、33GB/sの高速なメモリー帯域幅と組み合わされ、165Wの低消費電力でメインストリームサーバーに最適なPCIeカード上で動作します。

第3世代TensorコアとMIGを組み合わせることで、多様なワークロードに対して保証されたサービス品質を提供し、柔軟性のあるデータセンターを実現する汎用的なGPUの能力を活用できます。大規模なワークロードから小規模なワークロードまで対応可能な汎用性の高いA30のコンピューティング能力は、メインストリームの企業に最大限の価値をもたらします。

A30は、ハードウェア、ネットワーク、ソフトウェア、ライブラリ、NGCの最適化されたAIモデルとアプリケーションにわたるビルディングブロックで構成される完全なNVIDIAデータセンターソリューションの一部です。A30はデータセンター向けの最も強力なエンドツーエンドのAI/HPプラットフォームとして機能し、研究者は現実の成果を出し、ソリューションを大規模な運用環境へ展開できます。

製品情報

| 製品名 | NVIDIA A30 |

| 型番 | NVA30-24G |

| JANコード | なし |

| 価格 | オープンプライス |

| 同梱物 | 保証書 |

仕様

| 項目 | 内容 |

|---|---|

| アーキテクチャ | Ampere |

| GPUメモリー | 24GB HBM2 |

| メモリー帯域幅 | 最大933GB/s |

| ピークFP64 | 5.2TF |

| ピークFP64 Tensor core | 10.3TF |

| ピークFP32 | 10.3TF |

| TF32 Tensor core | 82TF/165TF* |

| BFLOAT16 Tensor core | 165TF/330TF* |

| ピークFP16 Tensor core | 165TF/330TF* |

| ピークINT8 Tensor core | 330TOPS/661TOPS* |

| ピークINT4 Tensor core | 661TOPS/1321TOPS* |

| NVIDIA NVLINK | 対応 |

| メディアエンジン | 1optical flow accelerator(OFA) 1JPEGデコーダー(NVJPEG) 4ビデオ デコーダー(NVDEC) |

| 相互接続 | PCIe Gen4:64GB/s 第3世代NVIDIA NVLINK 200GB/s** |

| 消費電力(TDP) | 165W |

| フォームファクター(mm) | 高さ111.76x長さ266.7 DualSlot |

| Multi-Instance GPU(MIG) | 6GBのMIGが4つ 12GBのMIGが2つ 24GBのMIGが1つ |

| 仮想GPU (vGPU) ソフトウェア サポート |

NVIDIA AI Enterprise NVIDIA 仮想コンピュートサーバー |

| 電源コネクター | 1xCPU 8pin |

| 同梱物 | 保証書 |

*スパース性あり

オプション/保証

<製品保証>保証対象製品の交換(センドバック方式)

※ ユーザー起因はこの限りではありません

※ 交換後の保証期間は、元の保証期間の残存期間が適用されます

※ 仕様などは予告なしに変更されることがあります