nvidia-a100pcie-40g

600

rtbs_notarrows

#76b900

あらゆる規模で前例のない加速

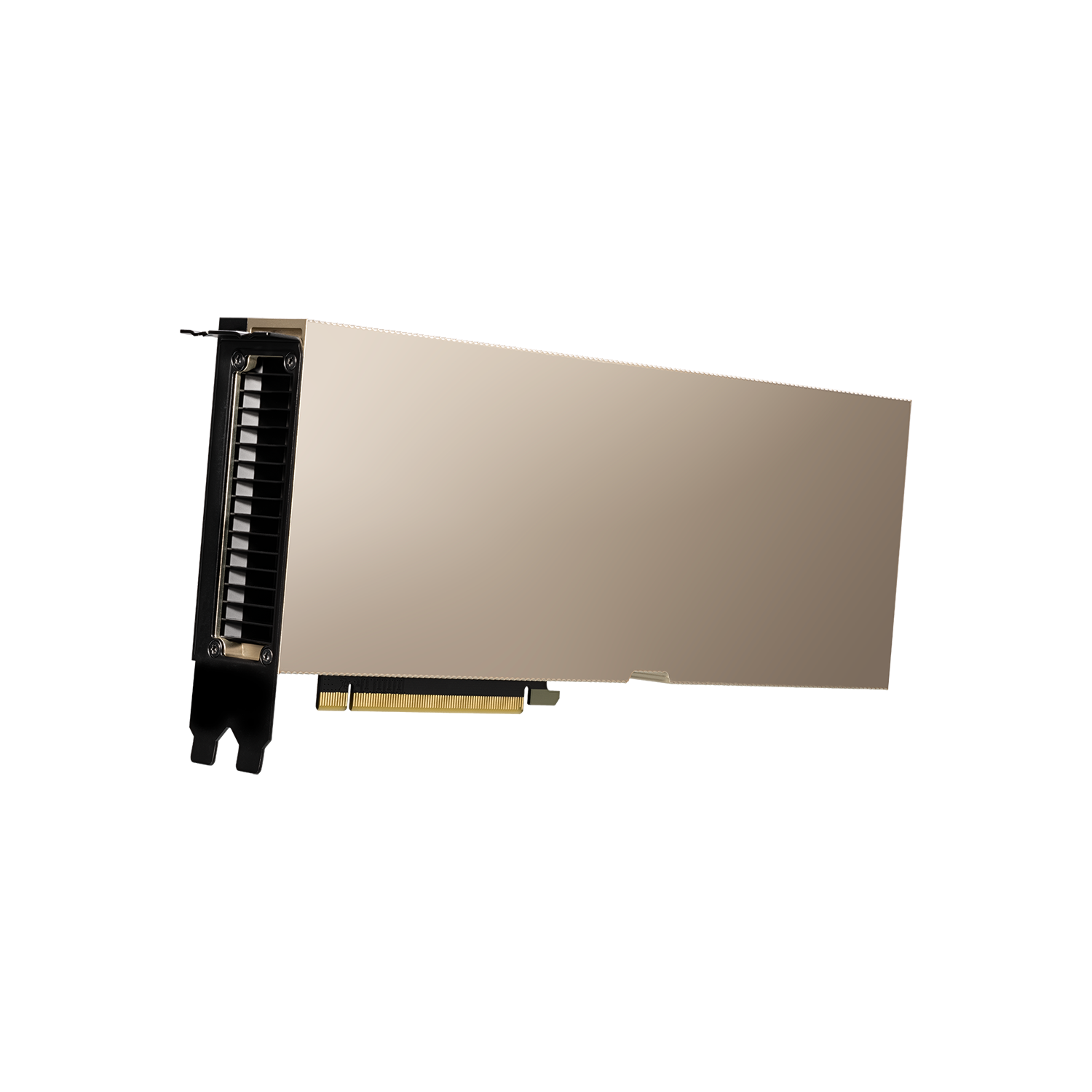

NVIDIA A100 TensorコアGPUは、NVIDIA Ampere (アンペア) アーキテクチャを採用し、AI、データ分析、およびHPCのあらゆる場面で前例のない加速を提供し、世界で最も困難なコンピューティングの課題に挑戦できます。

A100の第3世代のTensorコアテクノロジーは、多様なワークロードを高いレベルの精度で加速し、学習結果と市場投入までの時間を短縮します。

新たなデータフォーマットをサポート

NVIDIA A100の第3世代TensorコアとTensor Float (TF32) 精度を利用することで、前世代と比較して最大20 倍のパフォーマンスがコードを変更することなく得られます。

また、Automatic Mixed Precision (AMP) と FP16 の活用でさらに 2 倍の高速化が可能になります。

マルチインスタンスGPU(MIG)機能追加

第3世代のNVIDIA Tensorコアにより性能を大幅に向上できるようになり、さらに、新たに追加されたMIG(マルチインスタンス GPU)機能は、A100 GPUを7つのインスタンスに分割して、メモリ、キャッシュ、コンピューティングコアなどのリソースを割り当てて利用できることにより、演算要求の異なる様々な処理に最適な演算性能を提供します。

製品情報

| 製品名 | NVIDIA A100 Tensor Core GPU 40G |

| 型番 | NVA100-40G |

| JANコード | なし |

価格

オープンプライス

仕様

| アーキテクチャ | Ampere |

| 倍精度性能 | FP64 : 9.7TFLOPS FP64 Tensor Core : 19.5TFLOPS |

| 単精度性能 | FP32:19.5TFLOPS TF32:156TFLOPS (sparsity有効時312TFLOPS) |

| 半精度演算 | 312TFLOPS (sparsity有効時624TFLOPS) |

| Bfloat16 | 312TFLOPS (sparsity有効時624TFLOPS) |

| 整数性能 | INT8 : 624TOPS (sparsity有効時1,248TOPS) INT4 :1,248TOPS (sparsity有効時2,496TOPS) |

| GPU メモリー | 40GB HBM2 |

| メモリー帯域 | 1.6TB/s |

| エラー修正コード(ECC) | Yes |

| インターコネクト | PCIe4.0:64GB/s 第3世代NVLink : 600GB/s (2GPUでのNVLink Bridge利用時) |

| フォームファクタ | PCIe4.0 : 64GB/s 第3世代NVLink : 600GB/s (2GPUでのNVLink Bridge利用時) |

| マルチインスタンスGPU(MIG) | 最大7GPU |

| 最大消費電力 | 250W |

| 冷却機構 | パッシブ |

| コンピュートAPI | CUDA、DirectCompute、OpenCL、OpenACC |

※仕様・製品名・型番は事前のご連絡なく、変更になる可能性がございます。

同梱物

| 同梱物 | 順次アップデート |

オプション

| 製品名 | NVLINK For Ampere 2-SLOT Retail NVLINK For Ampere 3-SLOT Retail |

| 型番 | NVLINK FOR AMPERE 2S RETAIL NVLINK FOR AMPERE 3S RETAIL |

※オプション品

価格

オープンプライス(NVIDIA A100 Tensor Core GPU 40Gとは別途購入になります)

製品保証

※順次アップデート致します。

※ 仕様・製品名・型番は事前のご連絡なく、変更になる可能性がございます。